KOMMT IHNEN DAS BEKANNT VOR?

So erleben Kunden KI-Systeme,

die nicht optimal funktionieren

«Der Bot sagt etwas – aber das kann doch eigentlich nicht stimmen, oder?»

Die Antwort wirkt plausibel, doch es fehlen wichtige Informationen oder Aussagen bleiben unklar. Der Kunde fragt sich, ob das Gesagte im weiteren Servicekontakt überhaupt Bestand hat – oder bricht den Kontakt ab und meidet den Bot künftig.

«Reine Zeitverschwendung – der Bot kann mir nicht weiterhelfen.»

Der Kunde schildert sein Anliegen, doch der Bot reagiert unpassend oder mit Standardantworten. Es fehlt die Anbindung an Prozesse oder Systeme – das Anliegen bleibt offen und landet am Ende doch beim menschlichen Agenten.

«Oh nein, jetzt muss ich schon wieder von vorne anfangen …»

Der Bot kommt an seine Grenzen, der Dialog dreht sich im Kreis. Statt nahtlos an einen Agenten übergeben zu werden, beginnt das Gespräch nach der Übergabe wieder bei null. Der Kunde muss alles erneut erklären – und verliert die Geduld.

«Ich bin gerade echt verärgert – und das interessiert hier niemanden!»

Der Kunde schildert sein Anliegen mit Unmut und stößt auf einen Bot, der nur eine kurze Empathie-Floskel nutzt oder sachlich-distanziert antwortet. Es entsteht keine Bindung, kein Vertrauen – im schlimmsten Fall zusätzliche Verärgerung.

WAS WIR IN AUDITS FINDEN

Das Problem ist selten die Technik.

Es sind die Feinheiten, die den Unterschied machen zwischen einem System,

das antwortet – und einem, das wirklich hilft.

Plausibel, aber nicht belastbar

Der Bot halluziniert nicht – aber er dehnt vorhandenes Wissen so weit, dass Aussagen entstehen, die plausibel klingen, aber fachlich nicht belegbar sind. Das ist gefährlicher als ein offensichtlicher Fehler, weil Kunden der Aussage vertrauen.

Information statt Prozessführung

Der Bot beantwortet die Frage – aber führt den Kunden nicht durch den nächsten Schritt. Das Anliegen bleibt halb gelöst. Der Kunde erfährt, was er braucht – aber nicht, was er als Nächstes tun soll.

Sachlich korrekt, aber kein Service

Die Antwort stimmt inhaltlich. Aber der Bot spricht über das Unternehmen in der dritten Person, nutzt Fachsprache und klingt eher wie ein Regelwerk als wie ein Servicekontakt. Das schafft Distanz – genau dort, wo Vertrauen entstehen sollte.

Empathie als Floskel

Ein verärgerter Kunde erhält ein kurzes „Ich verstehe Ihre Enttäuschung“ – und dann sofort die nächste Sachaussage. Was fehlt, ist die spürbare Haltung: eine Kommunikation, die den Kunden ernst nimmt.

Woran liegt das?

In den meisten KI-Projekten im Kundenservice gibt es eine blinde Stelle: Der technische Integrator sorgt dafür, dass die Technik funktioniert. Die Fachbereiche liefern Content und definieren Anforderungen – meistens unter hohem Zeitdruck. Aber niemand prüft systematisch, ob das Ergebnis aus Sicht des Endkunden tatsächlich funktioniert.

Genau diese Lücke schließen wir.

DAS QUALITÄTSAUDIT

Was wir prüfen:

Drei Dimensionen der Servicequalität

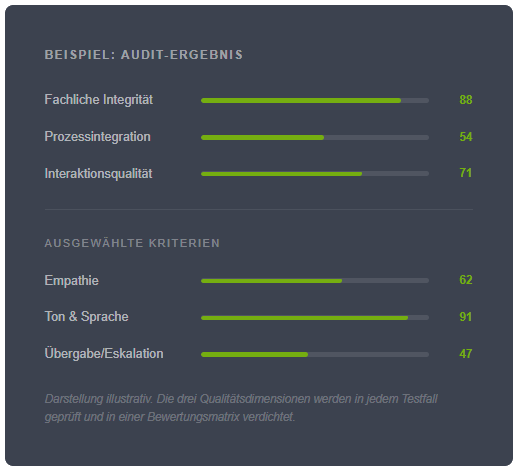

Das Audit bewertet jedes Dialogszenario entlang von drei Qualitätsdimensionen,

die zusammen das vollständige Bild der Servicequalität ergeben.

Fachliche Integrität

Sind die Aussagen korrekt, belegbar und kontexttreu? Wo liegen die Grenzen des Wissens – und wie geht das System damit um? Wir prüfen, ob Ihr Bot vertrauenswürdige Antworten gibt oder ob Wissenslücken zu riskanten Interpretationen führen.

Prozessintegration

Führt das System den Kunden zielgerichtet durch Serviceprozesse? Oder bleibt es bei der reinen Informationsausgabe? Wir bewerten, ob Ihr Bot Anliegen wirklich löst – von der Erstaufnahme bis zur Weiterleitung an die richtige Stelle.

Interaktionsqualität

Wie erlebt der Kunde die Kommunikation? Ist der Sprachstil serviceorientiert? Reagiert das System empathisch in anspruchsvollen Situationen? Wir prüfen, ob Ihr Bot als kompetenter Unternehmensvertreter wahrgenommen wird.

Ihr Einstieg – Unsere Empfehlung

Szenarienbasierte Qualitätsprüfung

Gezielte Ersteinschätzung Ihres Systems aus Endkundenperspektive. Anhand ausgewählter Dialogszenarien machen wir sichtbar, wie Ihr Bot im echten Kundenkontakt wirkt – oft zum ersten Mal überhaupt. Sie erhalten einen komprimierten Auditbericht mit Bewertungsmatrix, vertiefender Analyse und priorisierten Maßnahmenempfehlungen.

VERTIEFEND

Katalogbasierte Prüfung

Systematische Qualitätsprüfung mit umfassendem Prüfkatalog – Basisszenarien plus Varianten mit unterschiedlichen Fragetypen, Kundentypen und Grenzfällen.

GET STARTEDPROZESSPRÜFUNG

Ende-zu-Ende-Testung

Prüfung ganzer Dialogstrecken über mehrere Gesprächsschritte. Funktioniert die Prozessführung? Gelingt die Übergabe an menschliche Agenten?

GET STARTEDLAUFEND

Retest & Qualitätszirkel

Wiederkehrende Qualitätsprüfung nach Systemanpassungen oder Deployments – stellt sicher, dass Änderungen die gewünschte Wirkung erzielen.

GET STARTEDSO LÄUFT DAS AUDIT AB

Schritt für Schritt zum Ergebnis

Vorbereitung

Gemeinsam definieren wir den Prüfumfang: Welche Use Cases sollen getestet werden? Welche Szenarien sind für Ihre Kunden typisch? Welche Qualitätskriterien sind für Ihr Unternehmen besonders relevant? Auf dieser Basis erstellen wir die Testszenarien.

Durchführung

Wir testen Ihr KI-System mit den definierten Szenarien – so, wie ein echter Kunde es erleben würde. Jeder Dialog wird anhand von 12 Qualitätskriterien systematisch bewertet und einer fünfstufigen Skala zugeordnet.

Auswertung & Empfehlungen

Sie erhalten einen komprimierten Auditbericht mit Bewertungsmatrix, vertiefender Analyse der größten Qualitätshebel und konkreten Maßnahmenempfehlungen – direkt umsetzbar.

Human in the Loop

KI unterstützt uns bei Testfallerstellung und Dokumentation. Aber die qualitative Bewertung jedes einzelnen Testfalls erfolgt durch einen Menschen mit über 25 Jahren Kundenservice-Erfahrung.

Ergebnispräsentation & nächste Schritte

Gemeinsame Besprechung der Ergebnisse und Ableitung konkreter nächster Schritte für Ihr Team – ob intern oder gemeinsam mit Ihrem technischen Integrator.

IHR AUDIT-ERGEBNIS

Was Sie erhalten

Bewertungsmatrix

Alle Testfälle auf einen Blick, mit Ampellogik für jede Qualitätsdimension. So erkennen Sie sofort, wo Ihr System stark ist und wo Handlungsbedarf besteht.

Tiefenanalyse

Vertiefende Analyse ausgewählter Dialogszenarien mit konkreten Belegfällen. Nicht abstrakt, sondern nachvollziehbar am echten Dialog.

Qualitätshebel

Identifikation der wirksamsten Stellschrauben für die Weiterentwicklung – priorisiert nach Wirkung auf die Kundenzufriedenheit.

Maßnahmenempfehlungen

Konkrete Handlungsschritte für Prompt-Anpassungen, Wissensbasis-Erweiterungen und Systemintegrationen – direkt umsetzbar durch Ihr Team oder Ihren Integrator.

Top-3-Empfehlung

Klare Priorisierung der drei wichtigsten nächsten Schritte. Damit wissen Sie sofort, womit Sie anfangen sollten.

NACH DEM AUDIT

Das Audit ist der Anfang,

nicht das Ende.

Je nach Ergebnis und Bedarf unterstützen wir Sie bei den nächsten Schritten.

Umsetzung begleiten

Wir arbeiten mit Ihrem Team und Ihrem technischen Integrator daran, die Empfehlungen umzusetzen: von der Optimierung des Systemprompts über die Aufbereitung der Wissensbasis bis zur Klärung von Schnittstellen und Übergabepunkten.

Wirksamkeit prüfen

Nach Systemanpassungen prüfen wir mit einem Retest, ob die Änderungen die gewünschte Wirkung auf die Servicequalität haben.

Interne Teams einbinden

In Workshops mit Ihren operativen Mitarbeitenden holen wir das Wissen aus dem Service-Alltag. Gemeinsam entwickeln wir Szenarien, werten Ergebnisse aus und priorisieren den Handlungsbedarf.

Qualität verankern

Wir helfen Ihnen, die Qualitätssicherung als festen Bestandteil Ihres Entwicklungszyklus zu etablieren – mit regelmäßigen Prüfungen und einem Team, das Qualität selbst mitgestalten kann.

This is one of the things we do best

With the Internet spreading linke wildfire and reaching every part of our daily life, more and more traffic is directed to websites in search for information.

FAQs zum KI-Dialogsystem-Audit

- KI-basierte Dialogsysteme sind nicht deterministisch – das stimmt. Aber unser Audit misst nicht, ob das System immer gleich antwortet. Wir prüfen, ob eine Antwort – wenn sie kommt – aus Kundensicht überzeugend ist: fachlich korrekt, prozessorientiert und serviceorientiert. Das sind zwei verschiedene Qualitätsfragen. Technische Konsistenztests ergänzen das Audit, ersetzen es aber nicht.

- Die Anzahl der Testfälle richtet sich nach dem Ziel des Audits: Für eine Ersteinschätzung genügen gezielte Szenarien, die die wichtigsten Kundenanliegen und Serviceprozesse abdecken. Für eine umfassende Qualitätsbewertung empfehlen wir mindestens 30 Szenarien mit variierten Eingaben – unterschiedliche Fragetypen, Kundenprofile, Grenzfälle. Die Testtiefe skaliert mit dem Leistungsumfang Ihres Systems.

- Nein. Das Audit ist ein Human-in-the-Loop-Verfahren. KI unterstützt bei der Erstellung von Testszenarien und bei der Dokumentation – aber die qualitative Bewertung jeder einzelnen Bot-Antwort erfolgt durch einen Menschen mit über 25 Jahren Kundenservice-Erfahrung. Ob eine Antwort einen verunsicherten Kunden überzeugt, ob der Sprachstil Vertrauen schafft, ob die Prozessführung aus Serviceperspektive schlüssig ist – das kann nur ein Mensch beurteilen, der weiß, wie guter Service funktioniert.

- Der Auditbericht ist ein reines Prüfdokument – er enthält die Bewertung und Maßnahmenempfehlungen, aber kein Angebot für Folgeleistungen. Die Empfehlungen können Sie mit Ihrem eigenen Team, Ihrem technischen Integrator oder mit uns umsetzen. Die Qualitätsbewertung steht für sich – unabhängig davon, wie es danach weitergeht.

- Systemanpassungen verändern das Antwortverhalten – deshalb empfehlen wir nach relevanten Änderungen einen Retest. So wird sichtbar, ob die Anpassungen die gewünschte Wirkung auf die Servicequalität haben. Audits lassen sich auch in einen iterativen Qualitätszyklus einbinden, um die Servicequalität kontinuierlich im Blick zu behalten.

- Viele Unternehmen warten, bis ihr KI-System live ist. Dabei ist gerade die Testphase vor dem Go-Live einer der wertvollsten Zeitpunkte für ein Audit – weil Anpassungen dann noch ohne Auswirkungen auf den laufenden Betrieb möglich sind. Aber auch bestehende Systeme profitieren: nach Systemupdates, nach der Anbindung neuer Datenquellen oder wenn das Service-Team vermehrt Rückmeldungen zu Auffälligkeiten gibt.

- Nein, wir sind kein technischer Integrator und geben keine Empfehlungen zur Systemauswahl oder Architektur. Was wir tun: Wir begleiten frühzeitig – zum Beispiel schon in der Testphase, bei der Aufbereitung von Wissensquellen für das KI-System, bei der Klärung von Schnittstellen zwischen Bot und Service-Team oder bei der Erarbeitung des Kompetenzrahmens für den Bot gemeinsam mit den operativen Teams. So stellen wir sicher, dass die Servicequalität von Anfang an mitgedacht wird – nicht erst nach dem Go-Live.

- Ausdrücklich ja. Die Auditergebnisse sind so aufbereitet, dass Ihr technischer Partner direkt damit arbeiten kann – mit konkreten Hinweisen zu Prompt-Anpassungen, Wissensbasis-Erweiterungen und Prozessintegration. Wir verstehen uns als Ergänzung zum Integrator, nicht als Konkurrenz: Wir bringen die Serviceperspektive ein, die in rein technischen Tests fehlt.

WARUM QUALITIKS

Hallo. Mein Name ist Monika Lex.

Seit 2008 bin ich selbständig im Kundenservice-Umfeld tätig – als Trainerin, Coach und Konzeptentwicklerin. In meiner Zeit als Referentin für Trainingsentwicklung in einem großen CallCenter habe ich gelernt, wie man Servicequalität systematisch aufbaut: durch Qualitätskriterien, Testszenarien, Coaching und kontinuierliche Verbesserung.

Diese Methodik übertrage ich heute auf KI-Dialogsysteme. Der Gedanke dahinter ist einfach: Ob ein Mensch oder eine KI den Kundenkontakt führt – die Qualitätsanforderungen bleiben dieselben. Ein guter Dialog ist ein guter Dialog.

Was mich antreibt: Ich möchte, dass KI im Kundenservice nicht nur technisch funktioniert, sondern aus Sicht der Kunden wirklich gut ist. Denn am Ende entscheidet nicht die Technik über den Erfolg eines KI-Systems – sondern das Erlebnis, das beim Kunden ankommt

Warum QualitiKs für Ihr KI-Audit

✓ 25+ Jahre Kundenservice-Erfahrung – nicht aus der Technik, sondern aus der Praxis

✓ Systematische Methodik: 12 Kriterien, 3 Dimensionen, strukturierte Testszenarien

✓ Human in the Loop – jede Bewertung durch einen Menschen, kein automatisiertes Scoring

✓ Unabhängig und herstellerneutral – der Auditbericht steht für sich

Sie möchten wissen, wie gut Ihr KI-Dialogsystem wirklich ist?

Vereinbaren Sie ein unverbindliches Gespräch – wir klären gemeinsam, ob und wie ein Audit für Sie sinnvoll ist.